کارت گرافیگ دیتاسنتر NVIDIA A100 80GB HBM2 PCIe TENSOR CORE GPU

برند و مدل: NVIDIA A100 80GB HBM2 PCIe TENSOR CORE GPU

کاربری: ورک استیشن، سرور، دیتاسنتر، HPC، Ai/DL/ML

- ریز معماری: انویدیا آمپر NVIDIA Ampere

- نام چیپ پردازنده گرافیکی: GH100

- تعداد هسته موازی کودا: 6912 Shading Units

- هسته تانسور: 432 Tensor Cores(Gen3)

- حافظه VRAM گرافیک: 80GB HBM2

- پهنای باند حافظه: 1.935TB/sec

- رابط حافظه: 5120bit

- عملکرد 9.7TFLOPS :FP64

- عملکرد 19.5TFLOPS :FP64 Tensor Core

- عملکرد 19.5TFLOPS :FP32

- عملکر د156TFLOPS* :FP32 Tensor Core

- عملکرد 312TFLOPS* :BFLOAT16 Tensor Core

- عملکرد 312TFLOPS* : FP16 Tensor Core

- عملکرد FP8 Tensor Core: —

- عملکرد 624TOPS* :INT8 Tensor Core

- سیستم خنک کننده: Passive

- اتصال داخلی: NVLink (600GB/s per GPU) / PCIe Gen4 (64GB/s)

- هوشمصنوعی سازمانی انویدیا: دارد. (NVIDIA AI Enterprise)

ارسال کالا: حدود 1تا 3 روز کاری(15 تا 35 روز کاری)

وضعیت محصول: آکبند

گارانتی: تا 36 ماه.

سرویس طلایی دکمه ها: مهلت تست و برگشت 7 روزه.

قابلیت ارتقا: تا چهار عدد در ورکاستیشن, هشت عدد در سرور.

*با پراکندگی (بدون Sparsity نصف این عدد)

Price range: ۲,۷۹۰,۰۰۰,۰۰۰ تومان through ۴,۴۹۰,۰۰۰,۰۰۰ تومان

کارت گرافیگ دیتاسنتر NVIDIA A100 80GB HBM2 PCIe TENSOR CORE GPU

کارت گرافیگ دیتاسنتر انویدیا هسته تنسور NVIDIA A100

NVIDIA A100 PCIe 80 GB کارت گرافیک حرفهای A100 PCIe 80 GB از شرکت NVIDIA است که در تاریخ ۲۸ ژوئن ۲۰۲۱ عرضه شد. این کارت گرافیک که با فناوری ۷ نانومتری ساخته شده و بر اساس پردازنده گرافیکی GA100 است، از DirectX پشتیبانی نمیکند. از آنجایی که A100 PCIe 80 GB از DirectX 11 یا DirectX 12 پشتیبانی نمیکند، ممکن است نتواند تمام بازیهای جدید را اجرا کند. پردازنده گرافیکی GA100 یک تراشه بزرگ با مساحت ۸۲۶ میلیمتر مربع و ۵۴۲۰۰ میلیون ترانزیستور است. این کارت گرافیک دارای ۶۹۱۲ واحد سایهزنی، ۴۳۲ واحد نقشهبرداری بافت و ۱۶۰ واحد ROP است.

همچنین شامل ۴۳۲ هسته تنسور است که به بهبود سرعت برنامههای یادگیری ماشینی کمک میکند. NVIDIA حافظه ۸۰ گیگابایتی HBM2e را با A100 PCIe 80 GB جفت کرده است که با استفاده از رابط حافظه ۵۱۲۰ بیتی به هم متصل شدهاند. پردازنده گرافیکی با فرکانس ۱۰۶۵ مگاهرتز کار میکند که میتواند تا ۱۴۱۰ مگاهرتز افزایش یابد، حافظه با فرکانس ۱۵۱۲ مگاهرتز کار میکند.

کارت گرافیک NVIDIA A100 PCIe 80 GB با دو اسلات، برق مورد نیاز خود را از یک کانکتور برق ۸ پین EPS با حداکثر توان مصرفی ۳۰۰ وات تامین میکند. این دستگاه فاقد اتصال نمایشگر است، زیرا برای اتصال مانیتور طراحی نشده است. A100 PCIe 80 GB با استفاده از رابط PCI-Express 4.0 x16 به بقیه سیستم متصل میشود. طول کارت ۲۶۷ میلیمتر، عرض آن ۱۱۱ میلیمتر است و دارای یک سیستم خنککننده دو اسلاته است.

ویژگیهای کلیدی:

- 80GB حافظه GPU از نوع HBM2e

- ۱.94TB/s پهنای باند حافظه

- 3X عملکرد آموزش DL نسبت به V100

- 249X عملکرد استنتاج AI نسبت به CPU

- 11X عملکرد HPC بیشتر از چهار سال گذشته

کارت گرافیک دیتاسنتر NVIDIA A100 80GB HBM2 PCIe Tensor Core GPU

شتاب بیسابقه در هر مقیاس

کارت گرافیک NVIDIA A100 Tensor Core GPU برای اجرای سنگینترین بارهای کاری در حوزههای هوش مصنوعی (AI)، تحلیل دادهها و محاسبات با کارایی بالا (HPC) طراحی شده است. این کارت با معماری NVIDIA Ampere ساخته شده و قلب پلتفرم دیتاسنترهای NVIDIA محسوب میشود.

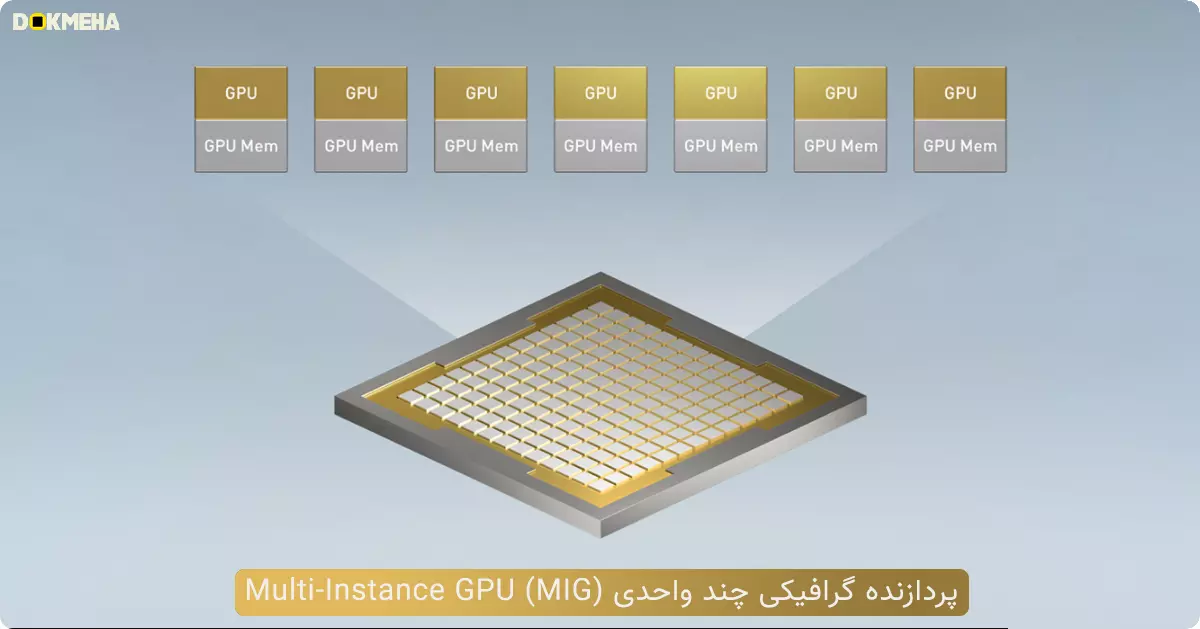

A100 نسبت به نسل قبلی تا ۲۰ برابر سریعتر است و میتواند به ۷ بخش مستقل GPU تقسیم شود تا بهصورت پویا با تغییر نیازهای پردازشی سازگار گردد. مدل A100 80GB با ارائه پهنای باند بیش از ۲ ترابایت بر ثانیه سریعترین حافظه جهان را برای اجرای بزرگترین مدلها و دیتاستها در اختیار قرار میدهد.

نرمافزار آماده برای کسبوکارها در زمینه هوش مصنوعی

پلتفرم NVIDIA EGX™ شامل نرمافزارهای بهینهشده است که محاسبات شتابدهیشده را در سراسر زیرساخت ارائه میدهد. با استفاده از NVIDIA AI Enterprise، کسبوکارها میتوانند به مجموعهای جامع از نرمافزارهای بومی ابری هوش مصنوعی و تحلیل دادهها دسترسی پیدا کنند که بهطور بهینهشده، تایید شده و از سوی NVIDIA پشتیبانی میشود تا روی VMware vSphere با سیستمهای تاییدشده NVIDIA اجرا شود. NVIDIA AI Enterprise شامل فناوریهای کلیدی از NVIDIA برای استقرار سریع، مدیریت و مقیاسبندی بارهای کاری هوش مصنوعی در فضای ابری هیبریدی مدرن است.

قدرتمندترین پلتفرم هوش مصنوعی و HPC برای مراکز داده

A100 بخشی از راهحل کامل مراکز داده NVIDIA است که شامل اجزای مختلفی از سختافزار، شبکه، نرمافزار، کتابخانهها و مدلها و برنامههای هوش مصنوعی بهینهشده از NGC™ است. این پلتفرم قدرتمندترین پلتفرم جامع هوش مصنوعی و HPC برای مراکز دادهها است که به محققان این امکان را میدهد که نتایج دنیای واقعی را به سرعت ارائه دهند و راهحلها را در مقیاس وسیع به تولید منتقل کنند.

آموزش عمیق (Deep Learning Training)

– مدلهای هوش مصنوعی روز بهطور فزایندهای پیچیدهتر میشوند و نیازمند توان پردازشی عظیم هستند.

– هستههای تنسور A100 با قابلیت Tensor Float (TF32) تا ۲۰ برابر سریعتر از NVIDIA Volta عمل میکنند، بدون نیاز به تغییر کد.

– پشتیبانی از FP16 و محاسبات ترکیبی خودکار باعث ۲ برابر افزایش عملکرد اضافی میشود.

– با استفاده از NVLink®، NVSwitch™، PCIe Gen4، InfiniBand® و NVIDIA Magnum IO امکان مقیاسدهی تا هزاران کارت A100 فراهم است.

– برای مثال، آموزش مدل سنگین BERT از گوگل، با استفاده از ۲,۰۴۸ کارت A100 در کمتر از یک دقیقه انجام میشود (رکورد جهانی).

– در مدلهای بسیار بزرگ مانند DLRM، کارت A100 80GB تا ۱.۳ ترابایت حافظه یکپارچه در هر نود فراهم میکند و تا ۳ برابر سرعت بالاتر از A100 40GB ارائه میدهد.

استنتاج در یادگیری عمیق (Deep Learning Inference)

– پشتیبانی از طیف کامل دقتها از FP32 تا INT4

– فناوری MIG امکان اجرای چندین شبکه روی یک GPU را فراهم میکند.

– پشتیبانی از Structural Sparsity تا ۲ برابر افزایش عملکرد بیشتر ارائه میدهد.

– در مدلهای پیشرفته مانند BERT، کارت A100 تا ۲۴۹ برابر سریعتر از CPU استنتاج را انجام میدهد.

– در مدلهای پیچیده مانند RNN-T، ظرفیت حافظهی بالاتر A100 80GB موجب ۱.۲۵ برابر افزایش سرعت نسبت به A100 40GB میشود.

محاسبات با کارایی بالا (HPC)

– معرفی هستههای تنسور دقت دوگانه (Double Precision) بزرگترین جهش در عملکرد HPC از زمان معرفی GPU بوده است.

– شبیهسازی ۱۰ ساعته دقت دوگانه در A100 به زیر ۴ ساعت کاهش مییابد.

– استفاده از TF32 باعث افزایش تا ۱۱ برابر در عملیات ماتریسهای متراکم میشود.

– در نرمافزارهایی مانند Quantum Espresso، حافظه بیشتر A100 80GB تا ۲ برابر سرعت بالاتر را نسبت به مدل 40GB ارائه میدهد.

تحلیل دادههای عظیم (High-Performance Data Analytics)

– نیاز به توان پردازشی بالا، حافظه عظیم و مقیاسپذیری دارد.

– A100 با بیش از ۲ ترابایت بر ثانیه پهنای باند حافظه و پشتیبانی از NVLink و NVSwitch، قدرت پردازش دادههای عظیم را دارد.

– ترکیب با InfiniBand، NVIDIA Magnum IO™ و RAPIDS شتاب بیسابقهای به تحلیل دادهها میدهد.

– در بنچمارکهای Big Data، A100 80GB دو برابر سریعتر از A100 40GB عمل کرده است.

استفاده سازمانی (Enterprise-Ready Utilization)

– با فناوری MIG هر کارت A100 میتواند به ۷ بخش مستقل تقسیم شود.

– در مدل 40GB هر بخش تا ۵ گیگابایت حافظه دارد، اما در مدل 80GB این مقدار ۱۰ گیگابایت است.

– سازگار با Kubernetes، کانتینرها و مجازیسازی سرور

– تضمین کیفیت سرویس (QoS) برای هر کاربر و استفاده بهینه از منابع شتابدهی GPU

جمعبندی

NVIDIA A100 80GB HBM2 PCIe Tensor Core GPU قدرتمندترین GPU دیتاسنتری جهان است که برای هوش مصنوعی، HPC و تحلیل دادههای عظیم ساخته شده است. با شتابی بیسابقه، پهنای باند حافظه فوقالعاده و فناوریهای نوین مانند MIG، NVLink و TF32، این کارت انتخابی ایدهآل برای مراکز داده و سازمانهایی است که به دنبال بیشترین کارایی و بهرهوری هستند.

نوآوریهای انقلابی

معماری NVIDIA Ampere

چه از MIG برای تقسیم یک GPU A100 به نمونههای کوچکتر استفاده کنید، چه از NVLink برای اتصال چندین GPU برای سرعتبخشی به کارهای بزرگ مقیاس، A100 میتواند به راحتی نیازهای شتابدهی با اندازههای مختلف را مدیریت کند، از کوچکترین کارها تا بزرگترین کارهای چند گرهای. انعطافپذیری A100 به این معناست که مدیران IT میتوانند بیشترین بهرهوری را از هر GPU در مرکز داده خود در طول شبانهروز ببرند.

هستههای تنسور نسل سوم

GPU A100 از ۳۱۲ ترافلاپس (TFLOPS) عملکرد یادگیری عمیق بهره میبرد. این ۲۰ برابر بیشتر از عملیاتهای نقطه شناور تنسور در هر ثانیه (FLOPS) برای آموزش یادگیری عمیق و ۲۰ برابر بیشتر از عملیاتهای ترافلاپس تنسور در هر ثانیه (TOPS) برای استنتاج یادگیری عمیق نسبت به GPUهای نسل Volta است.

NVLink نسل بعدی

NVLink در A100 عملکرد ۲ برابر بالاتری نسبت به نسل قبلی خود دارد. وقتی با NVIDIA NVSwitch™ ترکیب شود، تا ۱۶ GPU A100 میتوانند در یک سرور با سرعت ۶۰۰ گیگابایت بر ثانیه به یکدیگر متصل شوند، که بالاترین عملکرد برنامهنویسی ممکن را در یک سرور منفرد ارائه میدهد. NVLink در GPUهای A100 از طریق بردهای سرور HGX A100 و در GPUهای PCIe از طریق پل NVLink برای حداکثر ۲ GPU قابل دسترسی است.

GPU چندنمونهای (MIG)

یک GPU A100 میتواند به حداکثر ۷ نمونه GPU تقسیم شود که کاملاً از هم ایزوله شدهاند، با حافظه، کش و هستههای محاسباتی اختصاصی خود. MIG به توسعهدهندگان دسترسی به شتابدهی نوآورانه برای همه برنامهها را میدهد و مدیران IT میتوانند شتابدهی مناسب را برای هر کار بهینه کنند، بهرهوری را بالا برده و دسترسی به هر کاربر و برنامه را گسترش دهند.

حافظه پهنباند (HBM2e)

با حداکثر ۸۰ گیگابایت حافظه HBM2e، A100 پهنباند سریعترین حافظه GPU جهان را با بیش از ۲ ترابایت بر ثانیه ارائه میدهد و همچنین کارایی استفاده از حافظه دسترسی تصادفی (DRAM) را با ۹۵٪ بهرهوری به نمایش میگذارد. A100 پهنباند حافظه ۱.۷ برابر بیشتر از نسل قبلی خود ارائه میدهد.

پراکندگی ساختاری

شبکههای هوش مصنوعی میلیونها تا میلیاردها پارامتر دارند. همه این پارامترها برای پیشبینی دقیق نیاز نیستند و برخی از آنها میتوانند به صفر تبدیل شوند، که مدلها را “پراکنده” میکند بدون اینکه دقت کاهش یابد. هستههای تنسور در A100 عملکرد تا ۲ برابر بالاتری برای مدلهای پراکنده دارند. در حالی که ویژگی پراکندگی بیشتر برای استنتاج AI مفید است، میتواند عملکرد آموزش مدلها را نیز بهبود بخشد.

اطلاعات فنی کارت گرافیگ انویدیا NVIDIA A100 80GB HBM2 PCIe TENSOR CORE GPU

| وزن | 3 کیلوگرم |

|---|---|

| کارایی و رده بندی | حرفه ای, دیتاسنتر, رندرینگ, علم داده (Data Science), کاربری صنعتی, محاسبه برنامه های کاربردی فشرده, هوش مصنوعی AI, ورک استیشن یا ایستگاه کاری, یادگیری عمیق DL, یادگیری ماشین ML |

| برند و سری | |

| مدل | NVIDIA A100 80GB HBM2 PCIe (TENSOR CORE GPU – Data Center PCIe – GPU Accelerator) |

| وضعیت محصول | |

| کارت گرافیک / Graphics Card | Release Date: Jun 28th, 2021 |

| پردازنده گرافیکی / Graphics Processor | GPU Name : GA100 GA100 GPU Notes: Tensor Cores: 3rd Gen Latest Drivers: |

| پیکربندی رندر / Render Config | Shading Units : 6912 |

| حافظه / Memory | Memory Size : 80 GB |

| سرعت اجرای پردازنده / Clock Speeds | Base Clock : 1065 MHz |

| صفحه نمایش / Display | No outputs |

| عملکرد نظری / Theoretical Performance | Pixel Rate: 225.6 GPixel/s |

| ویژگی های گرافیک / Graphics Features | DirectX : N/A |

| برخورداری از APIهای محاسباتی | CUDA, DirectCompute, OpenCL™, OpenACC |

| vGPU software support | — |

| vGPU profiles supported | — |

| پشتیبانی از تکنولوژیهای و ویژگی ها | — |

| طراحی برد / Board Design | Slot Width: Dual-slot |

| ابعاد | Slot Width: Dual-slot |

| نوع رابط | |

| پک | Customized – SXM, Original – PCIe |

| گارانتی | سرویس طلایی دکمه ها 10 روز مهلت تست و برگشت رایگان, گارانتی 18 ماهه معتبر داخلی, گارانتی 12 ماهه معتبر داخلی, گارانتی 24 ماهه معتبر داخلی, گارانتی 36 ماهه معتبر داخلی |

اطلاعات (لینک/PDF)

-

Datasheet (دیتاشیت یا خلاصه عملکرد و ویژگیهای فنی)

-

Product Brief (مختصر محصول)

-

لینک محصول در سایت NVIDIA.

-

دستورالعملهای توان(برق) برای محصولات ایستگاه کاری (یادداشت کاربردی)

-

لینک محصول در سایت PNY.

-

لینک محصول در سایت LEADTEK.

-

لینک محصول در سایت TECH POWER UP.

-

Video Encode and Decode GPU Support Matrix

تعداد نظرات 0

اولین نفری باشید که نظری را برای “کارت گرافیگ دیتاسنتر NVIDIA A100 80GB HBM2 PCIe TENSOR CORE GPU” می نویسید.

لطفا برای نوشتن نظرات ابتدا وارد حساب کاربری شوید.

هنوز دیدگاه یا پرسشی ثبت نشده است.